近年來手機相機的發展趨勢,不僅在數量上快速成長,在軟硬體設計上也不斷優化。據Google資料顯示,目前全世界有數十億支手機相機,其數量仍在快速成長中。在未來手機相機的發展裡,擁有更佳的像素、鏡頭和更大的光圈是初期大家所走的方向,近一年來大家則是會發現多相機鏡頭與具有深度感應器 (Depth Sensor)已成為各家手機相機的發展趨勢。

大家不難發現,現在手機多靠所謂的演算法、人工智慧來解決原本光學才能做到的成像效果。而Google具備軟體和機器學習的優勢,而在發展手機相機技術的過程中,不斷公開對外分享技術成果,不僅有助於驅動更快速的創新 ,也藉此吸引更多博士新秀加入Google AI研究團隊。

今(23)日台灣Google 特別邀請到 Google 傑出工程師 - Marc Levoy,來向台灣媒體分享 Google 的 Pixel 手機相機技術。

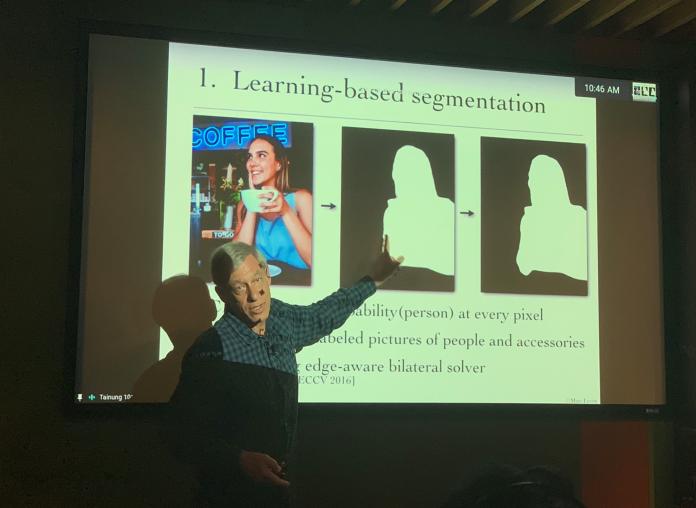

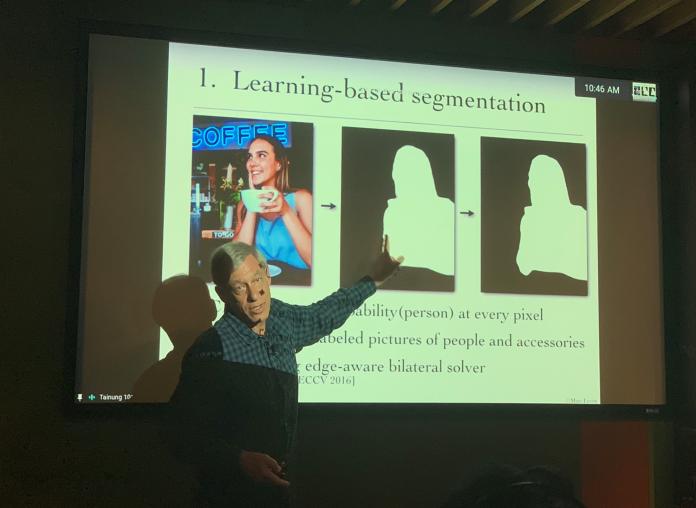

▲Marc Levoy是史丹佛大學電腦科學榮譽退休教授(該職由VMware創辦人所支持),他同時也是 Google 傑出工程師(Distinguished Engineer)。(圖/記者劉士成攝)

▲Marc Levoy是史丹佛大學電腦科學榮譽退休教授(該職由VMware創辦人所支持),他同時也是 Google 傑出工程師(Distinguished Engineer)。(圖/記者劉士成攝)

如果有使用過 Google Pixel 3 系列手機的「夜視模式」,一定會對其強悍的夜拍效果感到不可思議,明明就很黑暗的場景,竟然能拍得像白天一樣明亮。

原來,當使用者在按下快門後,觀景器將會靜止不動幾秒鐘,高速捕捉最多 15 幀畫面。Google表示,在夜晚景物的顏色依然存在,只不過人類的肉眼無法辨識,因此如何讓夜間拍攝的影像仍保有真實的色彩是一大挑戰。而藉由計算攝影的自動調整,就能保持景物最真實的色調。「夜視功能」可藉由計算攝影進行色調映射(Tone Mapping),讓影像保有原本的色彩。

接下來聊聊 Google Pixel 手機的「肖像模式」;Pixel 2 和Pixel 3 手機在僅有單一個後置鏡頭的條件下,拍攝人像時透過「Dual-Pixels」科技與機器學習來截取人的位置。而拍攝其他物體時,則是利用「雙像素」感光器來判斷深度。

▲Pixel 3 對雙像素進行了進一步的優化,加入了機器學習功能。(圖/記者劉士成攝)

▲Pixel 3 對雙像素進行了進一步的優化,加入了機器學習功能。(圖/記者劉士成攝)

為何 Google 捨棄增加2x以上的光學變焦鏡頭,答案就在其「高解析變焦」技術;雖然此功能背後並無搭載人工智慧及機器學習技術,但它可將多層影像合成為更高像素的照片,不僅提升照片細節的呈現之外,解析度 與許多搭載2x光學變焦鏡頭的智慧型手機不相上下。

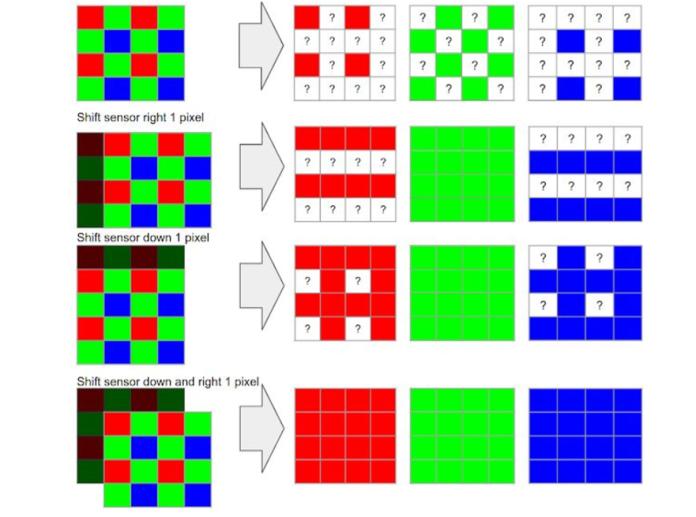

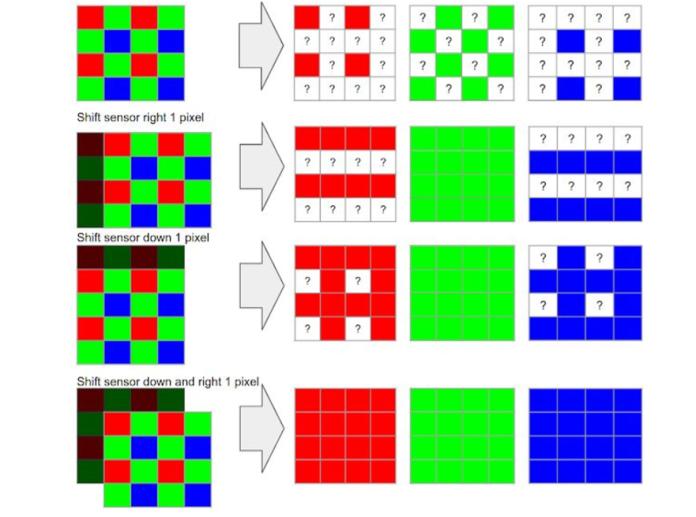

▲當相機同時拍攝了4幀畫面,其中三幀分別於水平、垂直,還有水平與垂直同時位移一個像素,組合這 4 幀畫面後會發現原先缺失的像素都被填滿,不必再執行去馬賽克。(圖/台灣Google提供)

▲當相機同時拍攝了4幀畫面,其中三幀分別於水平、垂直,還有水平與垂直同時位移一個像素,組合這 4 幀畫面後會發現原先缺失的像素都被填滿,不必再執行去馬賽克。(圖/台灣Google提供)

最後,分享Google Pixel手機相機應用中的HDR+技術;該技術捕捉曝光不足下的連拍影像,能透過捕捉在相同曝光程度下的連拍影像,並且避免亮處過度曝光。多張照片藉由進行校準與合併,並且應用色調映射(Tonemap),來增強陰影,然後犧牲整體色調和對比度,以保留局部對比度。

▲Google Pixel 3a XL手機採單鏡頭設計。(圖/記者劉士成攝)

▲Google Pixel 3a XL手機採單鏡頭設計。(圖/記者劉士成攝)

我是廣告 請繼續往下閱讀

今(23)日台灣Google 特別邀請到 Google 傑出工程師 - Marc Levoy,來向台灣媒體分享 Google 的 Pixel 手機相機技術。

▲Marc Levoy是史丹佛大學電腦科學榮譽退休教授(該職由VMware創辦人所支持),他同時也是 Google 傑出工程師(Distinguished Engineer)。(圖/記者劉士成攝)

▲Marc Levoy是史丹佛大學電腦科學榮譽退休教授(該職由VMware創辦人所支持),他同時也是 Google 傑出工程師(Distinguished Engineer)。(圖/記者劉士成攝)

如果有使用過 Google Pixel 3 系列手機的「夜視模式」,一定會對其強悍的夜拍效果感到不可思議,明明就很黑暗的場景,竟然能拍得像白天一樣明亮。

原來,當使用者在按下快門後,觀景器將會靜止不動幾秒鐘,高速捕捉最多 15 幀畫面。Google表示,在夜晚景物的顏色依然存在,只不過人類的肉眼無法辨識,因此如何讓夜間拍攝的影像仍保有真實的色彩是一大挑戰。而藉由計算攝影的自動調整,就能保持景物最真實的色調。「夜視功能」可藉由計算攝影進行色調映射(Tone Mapping),讓影像保有原本的色彩。

接下來聊聊 Google Pixel 手機的「肖像模式」;Pixel 2 和Pixel 3 手機在僅有單一個後置鏡頭的條件下,拍攝人像時透過「Dual-Pixels」科技與機器學習來截取人的位置。而拍攝其他物體時,則是利用「雙像素」感光器來判斷深度。

▲Pixel 3 對雙像素進行了進一步的優化,加入了機器學習功能。(圖/記者劉士成攝)

▲Pixel 3 對雙像素進行了進一步的優化,加入了機器學習功能。(圖/記者劉士成攝)

為何 Google 捨棄增加2x以上的光學變焦鏡頭,答案就在其「高解析變焦」技術;雖然此功能背後並無搭載人工智慧及機器學習技術,但它可將多層影像合成為更高像素的照片,不僅提升照片細節的呈現之外,解析度 與許多搭載2x光學變焦鏡頭的智慧型手機不相上下。

▲當相機同時拍攝了4幀畫面,其中三幀分別於水平、垂直,還有水平與垂直同時位移一個像素,組合這 4 幀畫面後會發現原先缺失的像素都被填滿,不必再執行去馬賽克。(圖/台灣Google提供)

▲當相機同時拍攝了4幀畫面,其中三幀分別於水平、垂直,還有水平與垂直同時位移一個像素,組合這 4 幀畫面後會發現原先缺失的像素都被填滿,不必再執行去馬賽克。(圖/台灣Google提供)

最後,分享Google Pixel手機相機應用中的HDR+技術;該技術捕捉曝光不足下的連拍影像,能透過捕捉在相同曝光程度下的連拍影像,並且避免亮處過度曝光。多張照片藉由進行校準與合併,並且應用色調映射(Tonemap),來增強陰影,然後犧牲整體色調和對比度,以保留局部對比度。

▲Google Pixel 3a XL手機採單鏡頭設計。(圖/記者劉士成攝)

▲Google Pixel 3a XL手機採單鏡頭設計。(圖/記者劉士成攝)